¿Qué es el archivo robots.txt?

Robots.txt es un archivo de texto creado por el usuario para controlar el acceso de los robots al alojamiento del sitio web. En él se establecen unas "recomendaciones" de indexación para que estos rastreadores de los motores de búsqueda se comporten de determinada manera, indicándoles cómo rastrear, lo que deben indexar y lo que no.

Con este archivo podemos alejar ciertas páginas de los buscadores o denegar el acceso de algunos de ellos a nuestro sitio.

¿Cómo es el archivo robots.txt de Blogger?

Para visualizarlo abrimos el navegador y escribimos en la barra de de dirección,

"URL del blog"/robots.txt

Se abrirá una página en el navegador que mostrará el contenido de nuestro archivo.

Accedo al archivo robots.txt de mi blog,

User-agent: Mediapartners-Google Disallow: User-agent: * Disallow: /search Allow: / Sitemap: http://prodpersonal.blogspot.com/sitemap.xml

User-agent: Mediapartners-Google

Disallow:

Se indica que todo el sitio puede ser rastreado por los robots de AdSense para mostrar publicidad.

User-agent: *

User-agent o agentes de usuario son los navegadores, motores de búsqueda, robots, mapeadores...que se conectan a la Web

Al indicar :* estamos dando instrucciones para todos los agentes.

¿Y qué indicaciones son?

Disallow: /search

Que lo que se encuentre en el directorio /search y en todas sus extensiones sea bloqueado. Es decir, se da indicaciones para que no se indexen las etiquetas del blog y evitar contenido duplicado.

Google no penaliza contenido duplicado excepto cuando su fin sea manipular los resultados de búsqueda. A pesar de ello debemos evitarlo porque consume más tiempo de búsqueda a los robots y ocasionará que Google rastree las páginas del blog con menor frecuencia.

Allow: /

La siguiente línea Allow: / significa que el resto del sitio puede ser rastreado.

Sitemap: http://prodpersonal.blogspot.com/sitemap.xml

La última línea le indica a Google dónde se encuentra el sitemap del blog.

¿Qué contenido duplicado puede ocasionar el archivo robots.txt de Blogger?

En el caso de mi blog, al buscarlo en Google he visto que tengo entradas duplicadas porque se muestran de forma independiente en los resultados pero su contenido se repite en las páginas que corresponden al archivo del blog (agrupadas por mes)

Si nos fijamos en la ruta de acceso de estas páginas, todas terminan con _archive.html.

Como no quiero que se muestren las páginas del archivo del blog, tengo que sugerir a los robots y motores de búsqueda que excluyan estas páginas y lo hago modificando el archivo robots.txt que tiene definido por defecto Blogger

¿Cómo agregar un archivo robots.txt personalizado en Blooger?

Modificar el archivo robots.txt en Blogger es sencillo pero debemos tener mucho cuidado y estar muy seguros de lo que hacemos porque afectará al rastreo e indexación de nuestro blog. Si no nos vemos seguros mi consejo es no tocar nada y dejarlo como está.

Para mi blog solo necesito por el momento restringir el acceso de los robots a las páginas del archivo del blog.

Voy al menú izquierdo de Blogger,

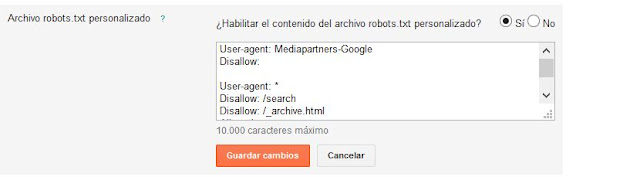

Configuración → Preferencias para motores de búsqueda → Editar "archivo robots.txt personalizado"

Copiamos las siguientes líneas y las pegamos dentro del cuadro de archivo.

User-agent: Mediapartners-Google Disallow: User-agent: * Disallow: /search

Disallow: /p/

Disallow: /*_archive.html$ Allow: / Sitemap: http://prodpersonal.blogspot.com/sitemap.xml

Guardamos cambios.

Se ha añadido dos nuevas líneas,

Disallow: /p/

que va a sugerir a los rastreadores y robots que se bloqueen las URLs de la carpeta p (menú páginas) y las ULRs de su contenido (subcarpetas).

Disallow: /*_archive.html$

que va a sugerir a los rastreadores y robots que se bloqueen las URLs que contengan y terminen ($) con _archive.html para que no se indexe su contenido (las páginas del archivo del blog).

Utilizo sugerir y no ordenar porque efectivamente es lo único que podemos hacer. Estos cambios no significan que los robots cumplan con las instrucciones de los comandos del archivo robots.txt porque es posible que el contenido bloqueado pueda aparecer en los resultados de Búsqueda. Solo queda confiar en la buena voluntad de los user-agents.

Otras instrucciones para el archivo robots.txt

*

Hace referencia a cualquier número de caracteres.

$

Indica que no debe haber más caracteres a continuación.

Disallow: *?*

Ordena no indexar las URLs con cualquier cadena de caracteres que estén antes de ? e indexar las URLs que contienen cualquier cadena de caracteres tras el signo ?.

Disallow: *?

Ordena no indexar las URLs con cualquier cadena de caracteres que estén

antes y después del signo ?.

Ordena no indexar las URLs que contienen search.

Ordena no indexar ninguna ruta que incluya search.

Ordena no indexar el directorio o carpeta search pero sí indexar su contenido o subcarpetas (por ejemplo ..../search/archive) .

Ordena no indexar los archivos con la extensión jpeg.

Disallow: *?$

Ordena no indexar las URLs con cualquier cadena de caracteres que terminen con el signo ?.

Ordena no indexar unicamente las URLs de la carpeta search (que terminen con /search) pero sí indexar su contenido o subcarpetas (por ejemplo ..../search/archive).

Ordena no indexar las URLs de la carpeta que empiecen por search.

Disallow: /search$

Disallow: /search*

Disallow: /*search

Disallow: /*/search

Disallow: /search/$

Disallow: /*.jpeg$

Es importante tener en cuenta que el archivo robots.txt distingue entre mayúsculas y minúsculas.